QVQ 72B Preview

简介 :

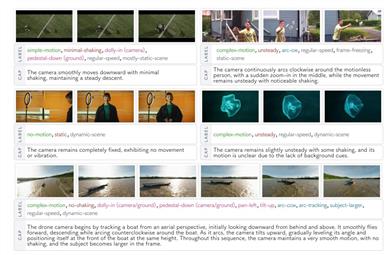

QVQ-72B-Preview是由Qwen团队开发的实验性研究模型,专注于增强视觉推理能力。该模型在多学科理解和推理方面展现出强大的能力,特别是在数学推理任务上取得了显著的进步。尽管在视觉推理方面取得了进步,但QVQ并不完全取代Qwen2-VL-72B的能力,在多步视觉推理中可能会逐渐失去对图像内容的关注,导致幻觉。此外,QVQ在基本识别任务上并没有显示出比Qwen2-VL-72B更显著的改进。

需求人群 :

目标受众为研究人员和开发者,特别是那些在视觉推理、多学科理解和数学推理领域寻求先进解决方案的专业人士。QVQ-72B-Preview提供了一个强大的工具,可以帮助他们处理复杂的视觉和文本数据,推动相关领域的研究和应用发展。

使用场景

- 使用QVQ-72B-Preview模型在MMMU基准测试中进行多学科理解和推理任务。

- 利用模型在MathVision基准测试中处理数学推理任务。

- 在OlympiadBench上应用模型解决具有挑战性的问题。

产品特色

- 多学科理解和推理:在MMMU基准测试中得分高达70.3%,展现了强大的多学科理解和推理能力。

- 数学推理任务:在MathVision基准测试中取得显著进步,突出了模型在数学推理任务上的能力。

- 挑战性问题解决:在OlympiadBench上的表现也展示了模型解决挑战性问题的能力。

- 单轮对话支持:目前模型仅支持单轮对话和图像输出,不支持视频输入。

- 安全性和伦理考量:需要稳健的安全措施以确保可靠和安全的性能。

- 性能和基准限制:在多步视觉推理中可能会逐渐失去对图像内容的关注,导致幻觉。

- 基本识别任务:在识别人、动物或植物等基本任务上并没有显示出比Qwen2-VL-72B更显著的改进。

使用教程

1. 安装qwen-vl-utils工具包,以便更便捷地处理各种类型的视觉输入。

2. 使用transformers库加载Qwen2VLForConditionalGeneration模型。

3. 从qwen_vl_utils导入process_vision_info函数来处理视觉信息。

4. 准备输入消息,包括系统角色的消息和用户角色的消息,用户消息中包含图像和文本。

5. 使用processor.apply_chat_template函数准备推理所需的文本。

6. 调用process_vision_info函数处理视觉信息。

7. 将文本和视觉输入传递给processor,准备模型输入。

8. 使用model.generate函数生成输出。

9. 使用processor.batch_decode函数解码生成的ID,获取最终的输出文本。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型多模态

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型图像生成

8.0M

智启未来,您的人工智能解决方案智库

简体中文