Internvl2 5 8B

简介 :

InternVL2_5-8B是由OpenGVLab开发的一款多模态大型语言模型(MLLM),它在InternVL 2.0的基础上进行了显著的训练和测试策略增强,以及数据质量提升。该模型采用'ViT-MLP-LLM'架构,集成了新增量预训练的InternViT与多种预训练语言模型,如InternLM 2.5和Qwen 2.5,使用随机初始化的MLP projector。InternVL 2.5系列模型在多模态任务上展现出卓越的性能,包括图像和视频理解、多语言理解等。

需求人群 :

目标受众为研究人员、开发者和企业,特别是那些需要进行图像和文本交互理解、多模态数据分析的专业人士。InternVL2_5-8B以其强大的多模态处理能力和高效率的训练策略,适合需要在图像识别、自然语言处理和机器学习领域进行创新应用的用户。

使用场景

- 使用InternVL2_5-8B进行图像描述和图像问答。

- 利用模型进行多语言的图像标注和分类。

- 将模型应用于视频内容的理解和分析。

产品特色

- 动态高分辨率多模态数据处理:能够处理单图像、多图像和视频数据集。

- 单一模型训练管道:包括MLP预热、ViT增量学习和全模型指令调整三个阶段。

- 渐进式扩展策略:通过先在较小的LLM上训练,然后将视觉编码器转移到更大的LLM上,无需重新训练。

- 训练增强技术:包括随机JPEG压缩和损失重加权技术,提高模型对噪声图像的鲁棒性。

- 数据组织和过滤:通过参数控制训练数据的组织,以及设计高效的数据过滤管道来移除低质量样本。

- 多模态能力评估:在多模态推理、数学、OCR、图表和文档理解等多个方面进行了评估。

- 语言能力评估:通过收集更多高质量的开源数据,过滤低质量数据,保持了纯语言性能。

使用教程

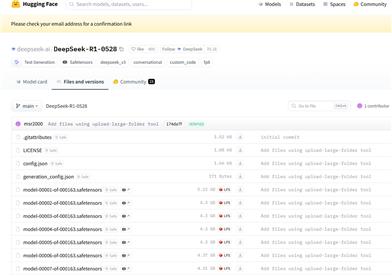

1. 安装必要的库,如torch和transformers。

2. 从Hugging Face加载模型和分词器。

3. 准备输入数据,包括图像和文本。

4. 对图像进行预处理,调整大小并转换为模型需要的格式。

5. 使用模型进行推理,获取图像和文本的交互理解结果。

6. 分析和应用模型输出的结果,例如自动图像标注或问答系统。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型多模态

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型图像生成

8.0M

智启未来,您的人工智能解决方案智库

简体中文