Llava Video

简介 :

LLaVA-Video是一个专注于视频指令调优的大型多模态模型(LMMs),通过创建高质量的合成数据集LLaVA-Video-178K来解决从网络获取大量高质量原始数据的难题。该数据集包括详细的视频描述、开放式问答和多项选择问答等任务,旨在提高视频语言模型的理解和推理能力。LLaVA-Video模型在多个视频基准测试中表现出色,证明了其数据集的有效性。

需求人群 :

目标受众为视频理解和多模态研究的科研人员、开发者以及对视频语言模型感兴趣的企业。LLaVA-Video提供的高质量合成数据集和先进的视频表示方法,能够帮助他们构建和优化更准确、更高效的视频理解模型,推动视频分析和多模态交互技术的发展。

使用场景

研究人员使用LLaVA-Video数据集训练自定义的视频语言模型,以提高模型在视频问答任务中的表现。

开发者利用LLaVA-Video模型的API,为移动应用开发视频内容分析功能,如视频搜索和推荐。

企业采用LLaVA-Video模型进行视频内容审核,自动识别和过滤不适宜的内容,提高内容管理效率。

产品特色

视频指令调优:通过合成数据集LLaVA-Video-178K进行训练,提高视频语言模型的指令跟随能力。

多任务处理:数据集涵盖视频描述、开放式问答和多项选择问答等多种任务类型。

高质量数据合成:利用GPT-4o生成详细的视频描述和多样化的问题回答对。

视频表示优化:采用SlowFast视频表示方法,平衡帧数和视觉标记的数量,提高GPU资源利用率。

跨数据集性能提升:结合现有视觉指令调优数据,通过LLaVA-Video-178K数据集训练,增强模型在多个视频基准测试中的表现。

开源资源:提供数据集、生成流程和模型检查点,促进学术界和工业界的进一步研究和应用。

使用教程

1. 访问LLaVA-Video的官方网站或GitHub页面,了解项目背景和模型特点。

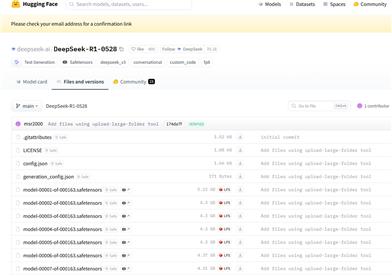

2. 下载LLaVA-Video-178K数据集,以及相应的模型检查点。

3. 根据提供的Training Code设置实验环境,包括安装必要的依赖库和配置硬件资源。

4. 使用数据集对LLaVA-Video模型进行预训练或微调,以适应特定的视频理解和分析任务。

5. 利用训练好的模型进行视频内容的分析和处理,如视频描述生成、视频问答等。

6. 参考Interactive Demos部分,了解模型在实际应用中的示例和效果。

7. 根据需要,可以对模型进行进一步的定制和优化,以满足特定的业务需求。

精选AI产品推荐

Sora

Sora是一个基于大规模训练的文本控制视频生成扩散模型。它能够生成长达1分钟的高清视频,涵盖广泛的视觉数据类型和分辨率。Sora通过在视频和图像的压缩潜在空间中训练,将其分解为时空位置补丁,实现了可扩展的视频生成。Sora还展现出一些模拟物理世界和数字世界的能力,如三维一致性和交互,揭示了继续扩大视频生成模型规模来发展高能力模拟器的前景。

AI视频生成文本控制

17.2M

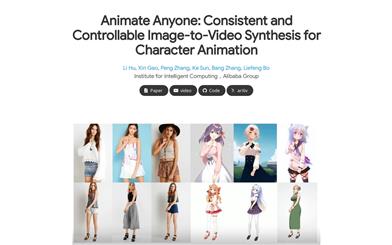

Animate Anyone

Animate Anyone旨在通过驱动信号从静态图像生成角色视频。我们利用扩散模型的力量,提出了一个专为角色动画量身定制的新框架。为了保持参考图像中复杂外观特征的一致性,我们设计了ReferenceNet来通过空间注意力合并详细特征。为了确保可控性和连续性,我们引入了一个高效的姿势指导器来指导角色的动作,并采用了一种有效的时间建模方法,以确保视频帧之间的平滑跨帧过渡。通过扩展训练数据,我们的方法可以为任意角色制作动画,与其他图像到视频方法相比,在角色动画方面取得了出色的结果。此外,我们在时尚视频和人类舞蹈合成的基准上评估了我们的方法,取得了最先进的结果。

AI视频生成图像到视频合成

11.8M

智启未来,您的人工智能解决方案智库

简体中文