Maia 100

简介 :

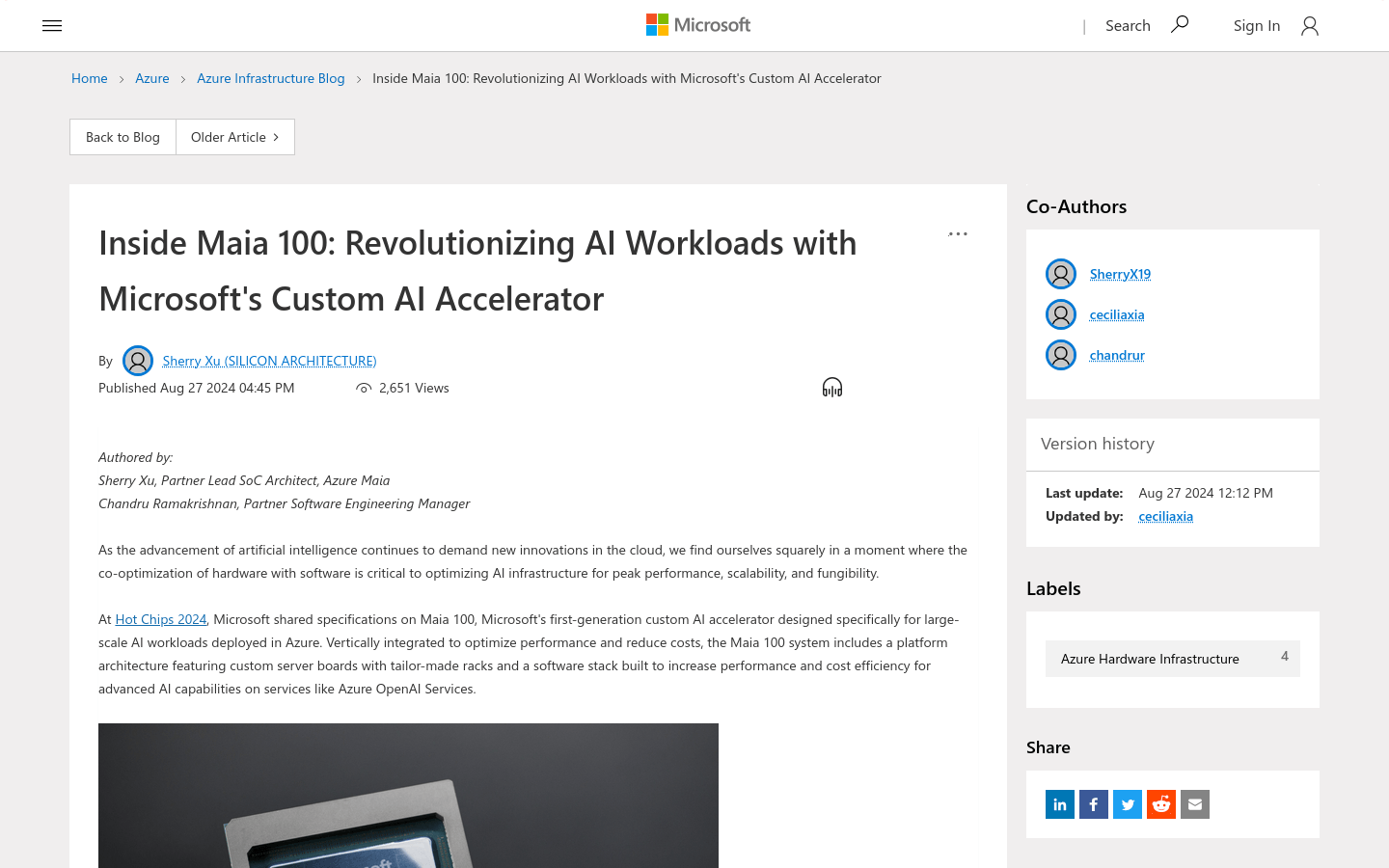

Maia 100是微软为Azure设计的首款定制AI加速器,专为大规模AI工作负载而打造,通过软硬件的协同优化,实现了性能、可扩展性和灵活性的最大化。它采用了TSMC N5工艺和COWOS-S互连技术,具备高达1.8TB/s的带宽和64GB的容量,支持高达700W的热设计功耗(TDP),但以500W运行,确保了高效的能效比。Maia 100集成了高速张量单元、向量处理器、DMA引擎和硬件信号量,支持多种数据类型和张量切分方案,并通过以太网互连支持大规模AI模型。此外,Maia SDK提供了丰富的组件,支持快速部署PyTorch和Triton模型,并通过双编程模型确保高效的数据处理和同步。

需求人群 :

Maia 100的目标受众是AI开发者和数据科学家,他们需要处理大规模的AI工作负载,如机器学习和深度学习任务。Maia 100的高性能、高带宽和低延迟特性,使其非常适合需要处理大量数据和进行复杂计算的场景。此外,Maia 100的灵活性和可扩展性,也使其能够适应不断变化的AI应用需求。

使用场景

在Azure平台上部署深度学习模型,利用Maia 100的高带宽和低延迟特性,实现快速训练和推理。

使用Maia SDK将现有的PyTorch或Triton模型迁移到Maia 100上,享受更高的性能和更低的延迟。

开发自定义内核,利用Maia 100的硬件可选性和灵活性,优化特定AI工作负载的性能。

产品特色

采用TSMC N5工艺和COWOS-S互连技术,提供高带宽和大容量。

支持高达700W的TDP,以500W运行,实现高效能效比。

集成高速张量单元和向量处理器,支持多种数据类型。

具备DMA引擎和硬件信号量,支持不同张量切分方案和异步编程。

支持以太网互连,提供超高速的all-gather和all-to-all带宽。

Maia SDK支持快速部署PyTorch和Triton模型,提供双编程模型。

使用教程

步骤1: 在Azure平台上创建Maia 100实例。

步骤2: 使用Maia SDK将PyTorch或Triton模型迁移到Maia 100上。

步骤3: 利用Maia SDK提供的工具进行模型调试和性能调优。

步骤4: 通过Maia SDK的编译器,将模型编译为Maia 100可执行的格式。

步骤5: 在Maia 100上运行编译后的模型,监控性能和资源使用情况。

步骤6: 根据需要调整模型参数和硬件配置,优化模型性能。

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型多模态

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型图像生成

8.0M

智启未来,您的人工智能解决方案智库

简体中文