Phi 3 Mini 4k Instruct Onnx

简介 :

Phi-3 Mini是一款轻量级的最先进的开源大模型,构建于用于Phi-2的合成数据和过滤网站数据之上,致力于提供极高质量、推理密集型的数据。该模型经过了严格的增强过程,结合了监督式微调和直接偏好优化,以确保精确遵循指令和强大的安全措施。该仓库提供了Phi-3 Mini的优化ONNX版本,可通过ONNX Runtime在CPU和GPU上进行加速推理,支持服务器、Windows、Linux、Mac等多种平台,并针对每个平台提供最佳精度配置。ONNX Runtime的DirectML支持还可让开发人员在AMD、英特尔和NVIDIA GPU驱动的Windows设备上实现大规模硬件加速。

需求人群 :

["- 企业:可将Phi-3 Mini集成到各种业务应用中,提供自然语言处理能力","- 开发者:可利用Phi-3 Mini强大的生成能力,开发各种语言相关的应用和服务"," - 如对话系统、问答系统、文本生成、数据分析等","- 个人用户:利用Phi-3 Mini输出高质量的自然语言内容,辅助写作、查询等需求"]

使用场景

1. 将Phi-3 Mini集成到企业的智能助理系统中,为客户提供自然语言交互和生成式服务

2. 基于Phi-3 Mini开发自动文本生成和创作辅助工具,为作家、内容创作者等提供创作支持

3. 利用Phi-3 Mini的推理能力构建数据分析和报告生成系统,自动生成分析报告

产品特色

- 支持多种硬件平台加速推理,包括:

- DirectML:适用于AMD、Intel和NVIDIA GPU的Windows设备,通过AWQ量化实现int4精度

- FP16 CUDA:适用于NVIDIA GPU,FP16精度

- Int4 CUDA:适用于NVIDIA GPU,通过RTN量化实现int4精度

- Int4 CPU和移动端:通过RTN量化实现int4精度,针对CPU和移动端提供两种版本以平衡延迟和精度

- 提供ONNX Runtime新的Generate()API,极大简化了在应用中集成生成式AI模型的流程

- 性能优异,相比PyTorch提高多达10倍,相比Llama.cpp提高多达3倍

- 支持大批量、长提示和长输出推理

- 量化后体积小,便于部署

使用教程

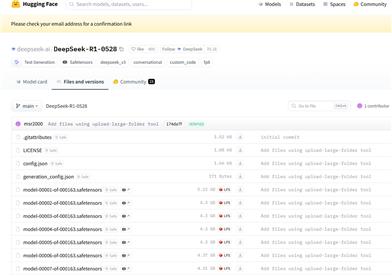

1. 前往Hugging Face页面下载所需的ONNX模型文件

2. 安装ONNX Runtime和ONNX Runtime Generate() API相关软件包

3. 在代码中加载ONNX模型文件

4. 使用ONNX Runtime Generate() API设置推理参数,如批量大小、提示长度等

5. 调用生成函数,输入文本提示

6. 获取输出结果并进行后续处理

精选AI产品推荐

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型多模态

11.4M

中文精选

Liblibai

LiblibAI是一个中国领先的AI创作平台,提供强大的AI创作能力,帮助创作者实现创意。平台提供海量免费AI创作模型,用户可以搜索使用模型进行图像、文字、音频等创作。平台还支持用户训练自己的AI模型。平台定位于广大创作者用户,致力于创造条件普惠,服务创意产业,让每个人都享有创作的乐趣。

AI模型图像生成

8.0M

智启未来,您的人工智能解决方案智库

简体中文