Qwen2 VL 7B

简介 :

Qwen2-VL-7B是Qwen-VL模型的最新迭代,代表了近一年的创新成果。该模型在视觉理解基准测试中取得了最先进的性能,包括MathVista、DocVQA、RealWorldQA、MTVQA等。它能够理解超过20分钟的视频,为基于视频的问题回答、对话、内容创作等提供高质量的支持。此外,Qwen2-VL还支持多语言,除了英语和中文,还包括大多数欧洲语言、日语、韩语、阿拉伯语、越南语等。模型架构更新包括Naive Dynamic Resolution和Multimodal Rotary Position Embedding (M-ROPE),增强了其多模态处理能力。

需求人群 :

Qwen2-VL-7B的目标受众包括研究人员、开发者和企业用户,特别是那些需要进行视觉语言理解和文本生成的领域。该模型可以应用于自动内容创作、视频分析、多语言文本理解等多个场景,帮助用户提高效率和准确性。

使用场景

案例一:使用Qwen2-VL-7B进行视频内容的自动摘要和问题回答。

案例二:集成Qwen2-VL-7B到移动应用中,实现基于图像的搜索和推荐。

案例三:利用Qwen2-VL-7B进行多语言文档的视觉问答和内容分析。

产品特色

- 支持各种分辨率和比例的图像理解:Qwen2-VL在视觉理解基准测试中取得了最先进的性能。

- 理解超过20分钟的视频:Qwen2-VL能够理解长视频,支持高质量的视频问题回答和对话。

- 集成到移动设备和机器人等设备中:Qwen2-VL具备复杂推理和决策能力,可以集成到移动设备和机器人中,实现基于视觉环境和文本指令的自动操作。

- 多语言支持:Qwen2-VL支持多种语言的文本理解,包括大多数欧洲语言、日语、韩语、阿拉伯语、越南语等。

- 任意图像分辨率处理:Qwen2-VL可以处理任意图像分辨率,提供更接近人类视觉处理的体验。

- 多模态旋转位置嵌入(M-ROPE):Qwen2-VL通过分解位置嵌入来捕获1D文本、2D视觉和3D视频位置信息,增强其多模态处理能力。

使用教程

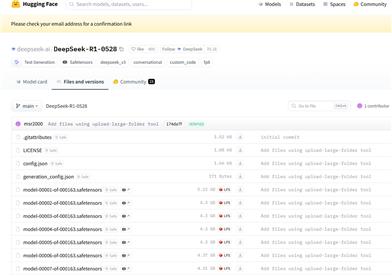

1. 安装最新版本的Hugging Face transformers库,使用命令`pip install -U transformers`。

2. 访问Qwen2-VL-7B的Hugging Face页面,了解模型的详细信息和使用指南。

3. 根据具体需求,选择合适的预训练模型进行下载和部署。

4. 使用Hugging Face提供的工具和接口,将Qwen2-VL-7B集成到自己的项目中。

5. 根据模型的API文档,编写代码以实现图像和文本的输入处理。

6. 运行模型,获取输出结果,并根据需要进行后处理。

7. 根据模型的输出,进行进一步的分析或应用开发。

精选AI产品推荐

国外精选

Pika

Pika是一个视频制作平台,用户可以上传自己的创意想法,Pika会自动生成相关的视频。主要功能有:支持多种创意想法转视频,视频效果专业,操作简单易用。平台采用免费试用模式,定位面向创意者和视频爱好者。

视频生成人工智能

18.7M

Deepmind Gemini

Gemini是谷歌DeepMind推出的新一代人工智能系统。它能够进行多模态推理,支持文本、图像、视频、音频和代码之间的无缝交互。Gemini在语言理解、推理、数学、编程等多个领域都超越了之前的状态,成为迄今为止最强大的AI系统之一。它有三个不同规模的版本,可满足从边缘计算到云计算的各种需求。Gemini可以广泛应用于创意设计、写作辅助、问题解答、代码生成等领域。

AI模型多模态

11.4M

智启未来,您的人工智能解决方案智库

简体中文