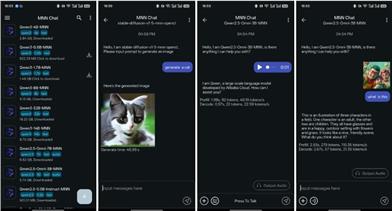

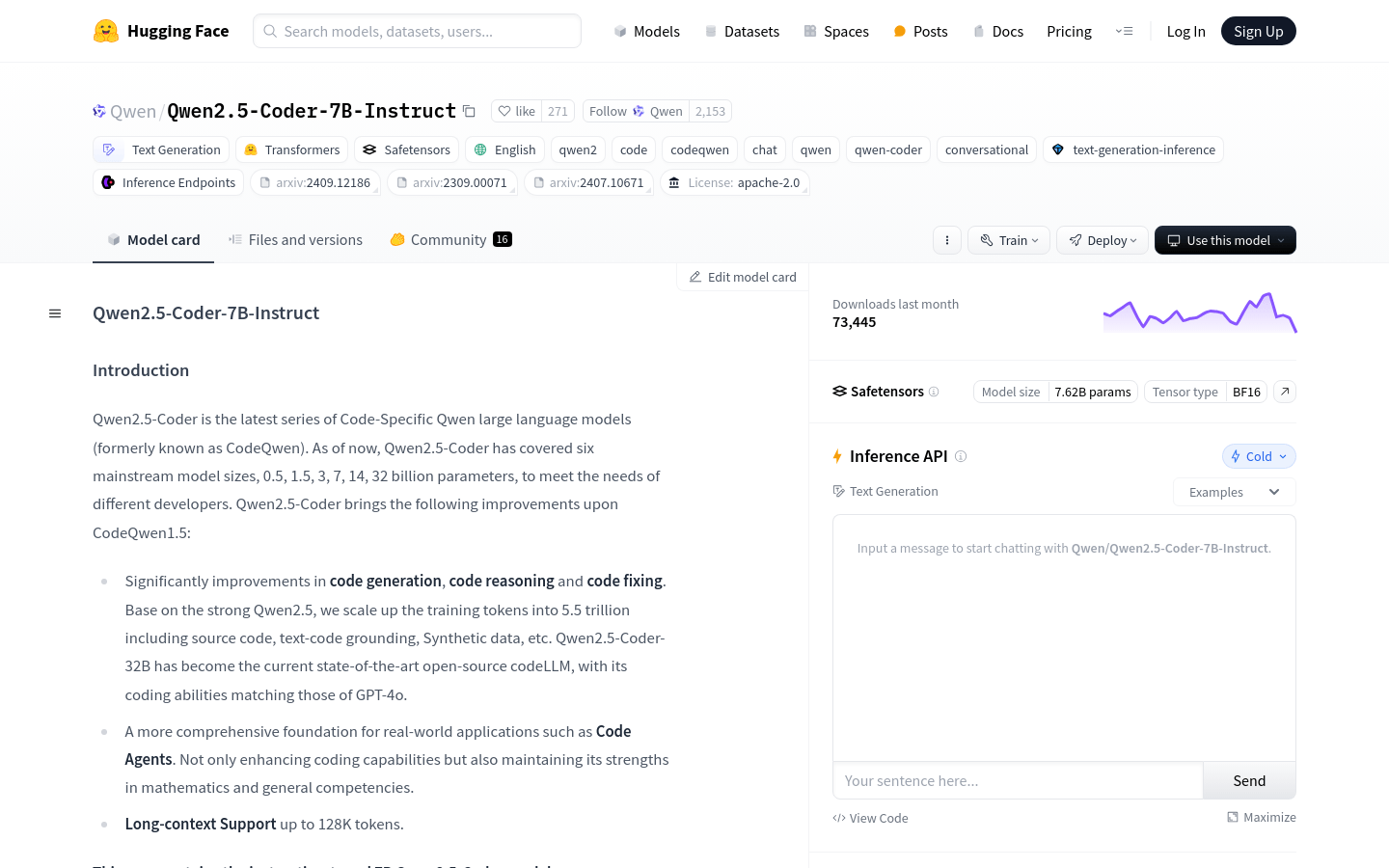

Qwen2.5 Coder 7B Instruct

简介 :

Qwen2.5-Coder-7B-Instruct是Qwen2.5-Coder系列中的一款代码特定大型语言模型,覆盖了0.5、1.5、3、7、14、32亿参数的六种主流模型尺寸,以满足不同开发者的需求。该模型在代码生成、代码推理和代码修复方面有显著提升,基于强大的Qwen2.5,训练令牌扩展到5.5万亿,包括源代码、文本代码基础、合成数据等。Qwen2.5-Coder-32B已成为当前最先进的开源代码LLM,其编码能力与GPT-4o相匹配。此外,该模型还支持长达128K令牌的长上下文,并为实际应用如代码代理提供了更全面的基础。

需求人群 :

目标受众为开发者和编程人员,特别是那些需要处理大量代码和复杂项目的人员。Qwen2.5-Coder-7B-Instruct能够提供代码生成、推理和修复等高级功能,帮助他们提高开发效率和代码质量。

使用场景

开发者使用Qwen2.5-Coder-7B-Instruct生成一个快速排序算法的代码。

软件工程师利用模型修复现有代码库中的bug。

数据科学家使用模型生成数据处理和分析的代码。

产品特色

代码生成:显著提升代码生成能力,支持多种编程语言。

代码推理:增强代码理解能力,帮助开发者推理代码逻辑。

代码修复:自动检测并修复代码中的错误。

长上下文支持:支持长达128K令牌的长上下文,适合处理大型代码库。

基于Transformers架构:使用RoPE、SwiGLU、RMSNorm和Attention QKV偏置等先进技术。

参数数量:拥有7.61B个参数,非嵌入参数为6.53B。

层数和注意力头:具有28层和28个Q的注意力头以及4个KV的注意力头。

适用于实际应用:不仅增强编码能力,还保持在数学和通用能力方面的优势。

使用教程

1. 访问Hugging Face平台并找到Qwen2.5-Coder-7B-Instruct模型。

2. 根据页面提供的代码片段,导入AutoModelForCausalLM和AutoTokenizer。

3. 使用模型名称加载模型和分词器。

4. 准备输入提示,例如编写一个特定功能的代码请求。

5. 将提示转换为模型可以理解的格式,使用tokenizer处理。

6. 将处理后的输入传递给模型,并设置生成参数,如最大新令牌数。

7. 模型生成响应后,使用tokenizer解码生成的令牌以获取最终结果。

8. 根据需要调整生成参数,以优化代码生成的效果。

精选AI产品推荐

Trae

Trae 是一款面向开发者的 AI 驱动的集成开发环境(IDE)。它通过智能代码补全、多模态交互以及对整个代码库的上下文分析等功能,帮助开发者更高效地编写代码。Trae 的主要优点在于其强大的 AI 能力,能够理解开发者的需求并提供精准的代码生成和修改建议。该产品目前提供免费版本,旨在帮助开发者减少重复性任务,专注于创造性工作,从而提升编程效率和生产力。

代码助手编程

1.8M

Fitten Code

Fitten Code是一个GPT驱动的代码生成和完成工具,支持多种语言:Python、Javascript、Typescript、Java等。它能够自动为您的代码补充缺失的部分,节省您宝贵的开发时间。基于AI大模型对代码进行语义级翻译,支持多种编程语言互译。同时,它能够根据您的代码自动生成相关注释,为您的代码提供清晰易懂的解释和文档。除此之外,它还拥有智能bug查找、解释代码、自动生成单元测试的功能,以及根据代码自动产生相应的测试用例等功能。

代码助手代码完成

1.0M

智启未来,您的人工智能解决方案智库

简体中文