Diffsensei

简介 :

DiffSensei是一个结合了多模态大型语言模型(LLMs)和扩散模型的定制化漫画生成模型。它能够根据用户提供的文本提示和角色图像,生成可控制的黑白漫画面板,并具有灵活的角色适应性。这项技术的重要性在于它将自然语言处理与图像生成相结合,为漫画创作和个性化内容生成提供了新的可能性。DiffSensei模型以其高质量的图像生成、多样化的应用场景以及对资源的高效利用而受到关注。目前,该模型在GitHub上公开,可以免费下载使用,但具体的使用可能需要一定的计算资源。

需求人群 :

目标受众为漫画创作者、艺术家、设计师以及对个性化内容生成感兴趣的研究人员和开发者。DiffSensei为他们提供了一个强大的工具,可以快速生成漫画风格图像,节省传统绘画所需的时间和资源,同时为漫画创作提供新的灵感和创作方式。

使用场景

漫画家使用DiffSensei根据剧本快速生成漫画草图。

设计师利用DiffSensei为客户定制个性化的漫画风格广告。

研究人员使用DiffSensei模型进行图像生成相关的学术研究。

产品特色

- 多分辨率漫画面板生成:支持64-2048边缘大小的漫画面板生成。

- 单一输入角色图像,创造多种外观:使用一个角色图像作为输入,可以生成多种不同的角色外观。

- 应用广泛:适用于定制化漫画生成和真人漫画创作。

- 灵活控制:用户可以通过调整参数来控制漫画面板的风格和内容。

- 高质量图像:生成的漫画面板图像质量高,细节丰富。

- 内存使用优化:提供了不使用MLLM组件的版本,显著降低内存消耗。

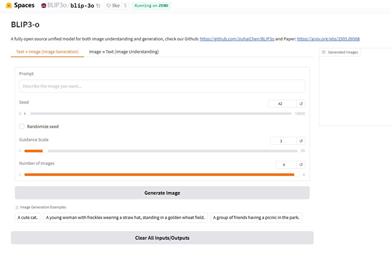

- 易于使用:通过Gradio界面,用户可以轻松地进行漫画生成。

使用教程

1. 安装环境:创建一个新的Conda环境,并激活。

2. 安装依赖:安装Pytorch、Diffusers、Transformers等相关包。

3. 下载模型:从Huggingface下载DiffSensei模型,并放置在指定的文件夹中。

4. 准备数据集:如果需要使用MangaZero数据集,从Huggingface下载并按照说明组织数据。

5. 运行Gradio演示:使用提供的命令行运行Gradio演示,进行漫画生成。

6. 调整参数:根据需要调整配置文件中的参数,以生成不同风格和大小的漫画面板。

7. 生成漫画:输入文本提示和角色图像,模型将生成相应的漫画面板。

精选AI产品推荐

中文精选

抖音即创

即创工作台是一个一站式的智能创意生产与管理平台。它集成了视频创作、图文创作、直播创作等多种创意工具,可以通过AI的力量大大提高创作效率。主要功能和优势包括:1)视频创作:内置多种AI视频创作工具,支持智能编剧、数字人物、一键成片等,可快速生成高质量视频内容;2)图文创作:提供智能图文和商品图片生成工具,可快速制作微信文章、产品详情等图文内容;3)直播创作:支持AI直播背景、直播文案等创作工具,可轻松制作抖音、快手等直播内容。定位为新创和创意从业者的创意助手,以合理价格提供创意生产全流程服务。

AI设计工具内容生产

106.7M

神采 PromeAI

神采 PromeAI 拥有强大的人工智能驱动设计助手和广泛可控的 AIGC(C-AIGC)模型风格库,使你能够轻松地创造出令人惊叹的图形、视频和动画,是建筑师、室内设计师、产品设计师和游戏动漫设计师的必备工具。

AI设计工具创意

8.4M

智启未来,您的人工智能解决方案智库

简体中文